Déployer un assistant IA sur Telegram pour votre entreprise

Telegram dépasse les 950 millions d'utilisateurs actifs mensuels selon la documentation officielle de l'API Telegram. Ce n'est plus un réseau de niche. Pour une part croissante des équipes commerciales et du support client, c'est devenu le canal de messagerie principal, devant email et parfois WhatsApp.

Ce déplacement crée une opportunité concrète : déployer un assistant IA directement là où vos clients et collaborateurs passent déjà du temps. Pas besoin de leur demander d'adopter un nouvel outil. L'assistant arrive dans leur interface habituelle.

On a déployé plusieurs de ces systèmes chez des clients PME ces derniers mois. Voici ce qui marche, ce qui coince, et comment s'y prendre sans partir d'une feuille blanche.

Ce que fait concrètement un assistant IA Telegram

La question qu'on entend toujours : "Mais qu'est-ce qu'il fait, concrètement ?" Bonne question. Un bot Telegram seul, sans intelligence, ne sert pas à grand-chose. C'est l'ajout d'un LLM derrière qui change tout.

Cas d'usage réels chez nos clients :

- Support client de premier niveau : le bot répond aux questions fréquentes, consulte la base de connaissance, escalade à un humain si la question dépasse son périmètre

- Qualification de prospects entrants : formulaire conversationnel qui récupère les besoins, le budget, le timing, et envoie un résumé au commercial

- Assistant interne pour les équipes terrain : techniciens ou commerciaux qui posent des questions via Telegram, l'IA répond en consultant les documents techniques ou les stocks

- Notifications enrichies : le bot n'attend pas les questions, il pousse des alertes métier et répond aux relances

Ce qui distingue un assistant IA d'un simple chatbot à règles, c'est la compréhension du langage naturel. Pas besoin que l'utilisateur tape exactement les bons mots-clés. Et si vous voulez creuser les différences architecturales, notre article sur les chatbots IA pour le support client en entreprise détaille ça bien.

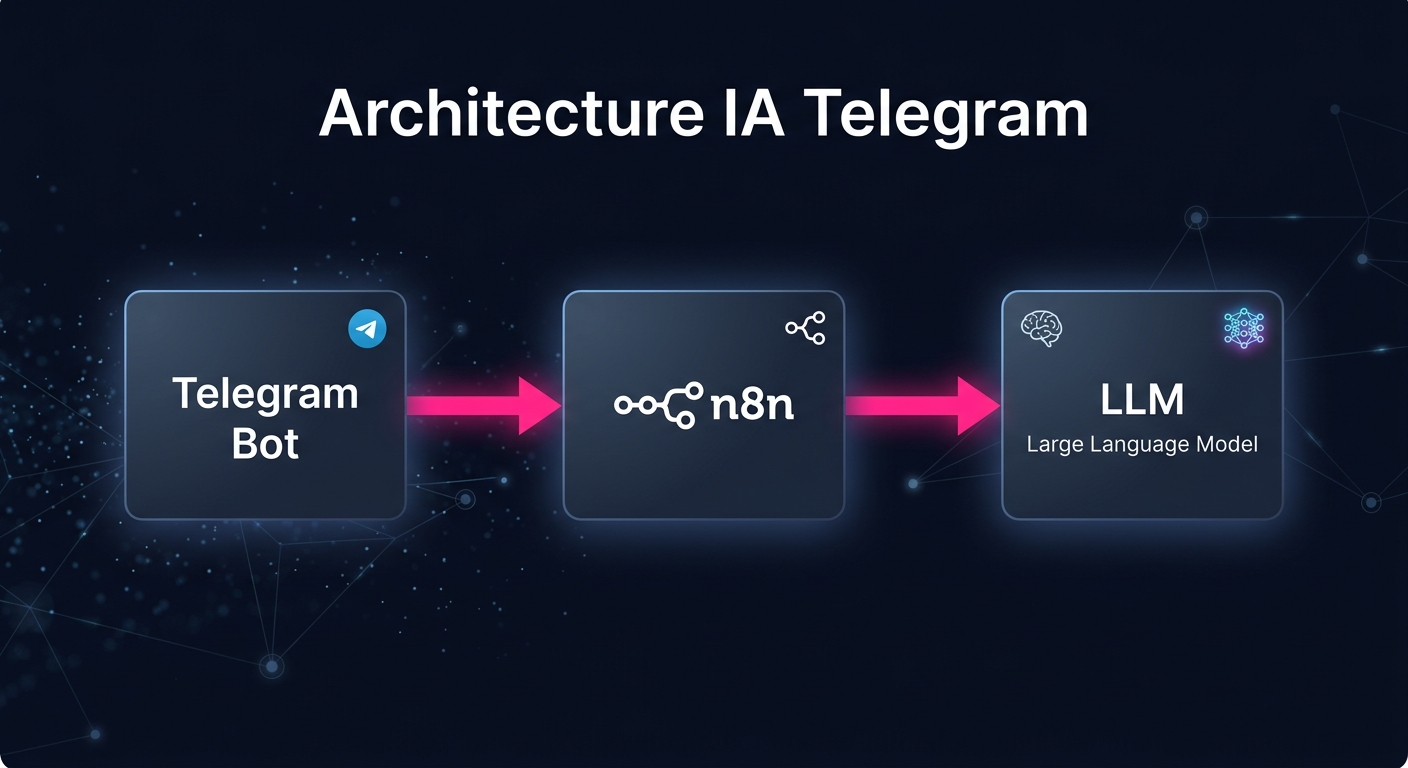

L'architecture en trois pièces

Un assistant IA Telegram repose sur trois composants qui s'articulent ensemble :

1. Le Bot Telegram (la couche interface). Créé via @BotFather, il a un token API unique. C'est lui qui reçoit les messages et renvoie les réponses. Rien d'intelligent ici, c'est un relay.

2. L'orchestrateur (la logique). N8n, Make, ou du code Python/Node.js. Il reçoit les messages entrants via webhook, décide quoi faire, appelle le LLM, gère la mémoire de conversation, et renvoie la réponse au bot. C'est là que ça se passe.

3. Le LLM (le cerveau). GPT-4o, Claude Sonnet, Mistral Large selon vos contraintes RGPD. Il reçoit le contexte de la conversation, la base de connaissance pertinente, et génère la réponse.

Pourquoi n8n comme orchestrateur ? Parce qu'il est auto-hébergeable (donc souveraineté des données), qu'il a un node Telegram natif avec trigger webhook et toutes les opérations nécessaires, et que le visuel des workflows aide à maintenir la logique dans la durée. Pour les équipes qui partent de zéro avec n8n, notre guide sur la création d'agents IA avec n8n couvre les bases.

Déploiement en 4 étapes

Étape 1 : Créer le bot Telegram

Envoyez `/newbot` à @BotFather sur Telegram. Choisissez un nom et un username (doit finir par "bot"). Vous récupérez un token API de la forme `12345678:AAHdqTcvCH...`. Gardez-le confidentiel, c'est votre clé d'accès complète au bot.

Si vous voulez que le bot fonctionne dans des groupes (pas juste en 1-1), activez également le mode "Group Privacy off" dans @BotFather, sinon il ne verra pas les messages qui ne le mentionnent pas directement.

Étape 2 : Installer et configurer n8n

L'option la plus propre pour une PME : n8n auto-hébergé via Docker. Notre guide d'installation n8n avec Docker couvre ça en 10 minutes. Vous pouvez aussi utiliser n8n Cloud si vous ne voulez pas gérer l'infra.

Dans n8n, créez un nouveau workflow. Ajoutez un noeud "Telegram Trigger" : c'est lui qui expose un endpoint webhook que Telegram appellera à chaque message entrant. Copiez l'URL du webhook générée par n8n.

Étape 3 : Brancher le webhook

Enregistrez le webhook Telegram avec un appel API simple :

curl -X POST "https://api.telegram.org/bot{VOTRE_TOKEN}/setWebhook" \

-H "Content-Type: application/json" \

-d '{"url": "https://votre-n8n.exemple.com/webhook/telegram"}'À partir de là, chaque message envoyé au bot déclenche votre workflow n8n. Vous voyez les données arriver dans le panneau d'exécution : l'ID de l'utilisateur, le texte du message, l'ID du chat.

Étape 4 : Ajouter l'intelligence

Dans le workflow n8n, après le Telegram Trigger, enchaînez :

- Un noeud "AI Agent" (ou un noeud HTTP Request vers l'API OpenAI / Anthropic / Mistral)

- Un noeud mémoire de conversation pour maintenir le contexte entre les messages

- Un noeud "Send Message" Telegram pour renvoyer la réponse

Le LLM reçoit un prompt système qui définit le rôle et le périmètre de l'assistant, l'historique de la conversation en cours, et éventuellement des documents récupérés par RAG si vous voulez qu'il consulte une base de connaissance. Si vous explorez cette architecture plus loin, l'article sur les agents IA sur mesure en entreprise couvre les patterns de mémoire et de retrieval.

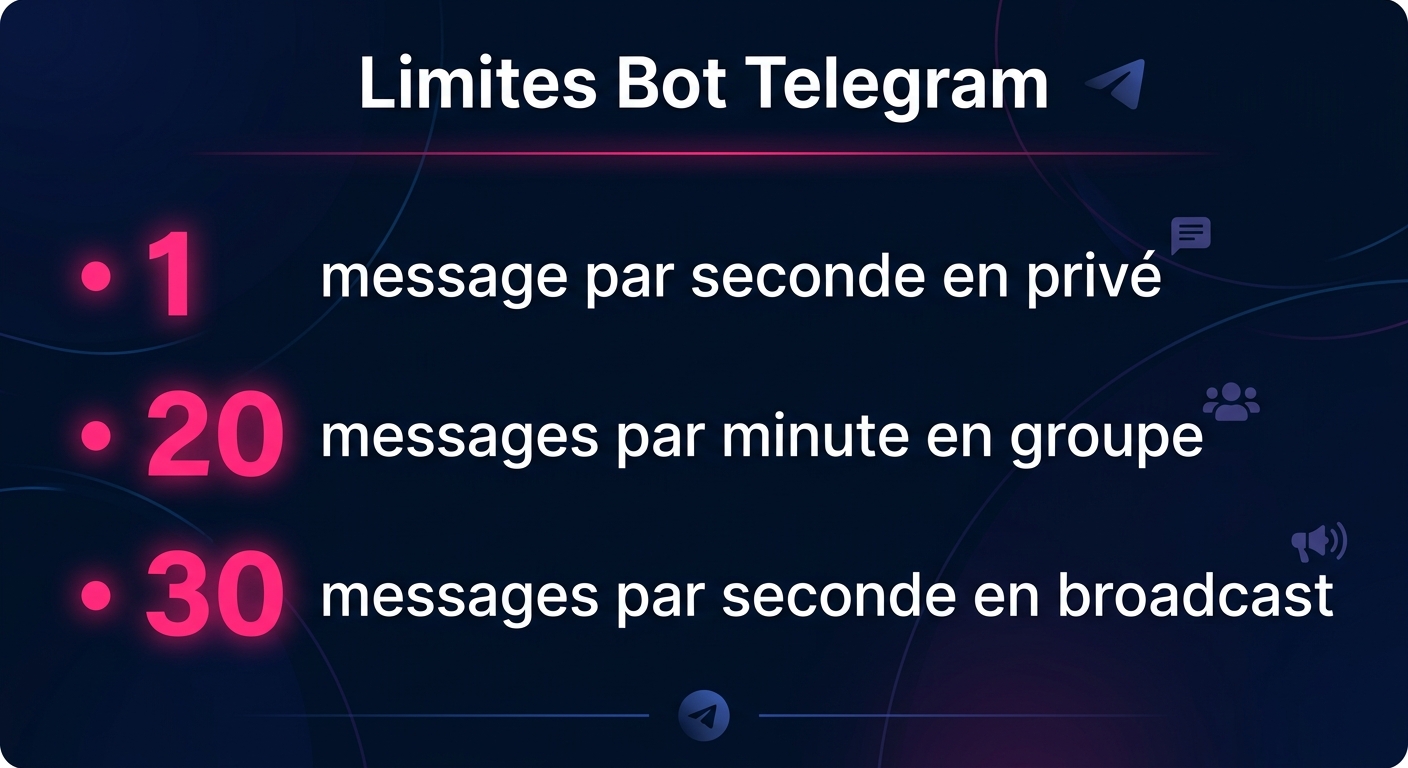

Les limites techniques à connaître avant de déployer

Telegram impose des rate limits documentés sur les bots que beaucoup ignorent jusqu'à tomber dessus en production :

- Messages privés (bot vers utilisateur) : pas plus d'1 message par seconde en soutenu

- Messages dans un groupe : maximum 20 messages par minute

- Broadcast (envoi massif) : 30 messages par seconde, au-delà vous recevez des erreurs 429

Pour du support client ou un assistant interne, ces limites ne posent aucun problème. Pour une campagne de notifications massives vers des milliers d'utilisateurs, il faut implémenter une queue et gérer les 429 avec backoff exponentiel.

Autre limite : les fichiers uploadés via l'API standard sont limités à 50 MB. Si votre assistant doit traiter des documents volumineux, il faut passer par un Bot API local (qui monte à 2 000 MB), mais ça complexifie l'infra.

Côté RGPD : les messages transitent par les serveurs de Telegram, dont l'infrastructure est distribuée. Si vous traitez des données sensibles, hébergez le LLM en Europe et limitez ce que vous stockez côté n8n. Notre article sur l'hébergement IA en France et le RGPD détaille les exigences réglementaires.

Quand ça vaut vraiment le coup

Le marché des outils d'IA conversationnelle atteint 14,29 milliards de dollars en 2025 et devrait dépasser 41 milliards en 2030 avec un CAGR de 23,7 %, selon Grand View Research. Mais la croissance du marché ne dit pas si c'est pertinent pour vous.

Un assistant IA Telegram crée de la valeur quand vos utilisateurs sont déjà sur Telegram, que les questions sont répétitives et documentables, et que le temps de réponse humain crée une friction visible. Si vos clients préfèrent l'email ou si vos questions sont trop complexes et contextuelées pour être traitées sans accès aux données métier, d'autres architectures s'imposent.

Ce n'est pas un gadget. C'est un canal de plus à maîtriser, avec ses contraintes propres. Et comme tout canal, il fonctionne mieux quand il est conçu pour un cas d'usage précis plutôt que déployé en mode "voyons ce que ça donne".

Si vous voulez qu'on évalue si c'est pertinent pour votre contexte, notre agence spécialisée en agents IA peut faire cette analyse avec vous avant de coder quoi que ce soit.

Questions fréquentes

Faut-il que mes clients aient un compte Telegram ?

Oui, c'est un prérequis. Telegram est gratuit et disponible sur iOS, Android et desktop, mais si votre base client utilise principalement WhatsApp ou SMS, un assistant Telegram n'est pas le bon choix. Évaluez d'abord les habituelles de communication de votre audience cible.

Quel LLM choisir pour un assistant Telegram en PME ?

Ça dépend de vos contraintes RGPD et de votre budget. GPT-4o Mini couvre 80 % des cas pour moins de 1 euro pour 1 000 000 de tokens d'entrée. Si vous avez des données sensibles, Mistral Small hébergé en France ou Claude Haiku d'Anthropic (datacenter UE) sont des options sérieuses. La décision appartient à l'entreprise, pas à l'intégrateur.

Combien de temps pour déployer un premier assistant fonctionnel ?

Un assistant basique (questions-réponses sur une base de connaissance simple) se déploie en une à deux journées avec n8n. Un système avec mémoire de conversation persistante, escalade vers un humain et connexion à votre CRM demande plutôt une à deux semaines selon la complexité de vos données sources.